克雷西发自凹非寺

量子位公众号 QbitAI

关于 Llama 3,又有测试结果新鲜出炉——

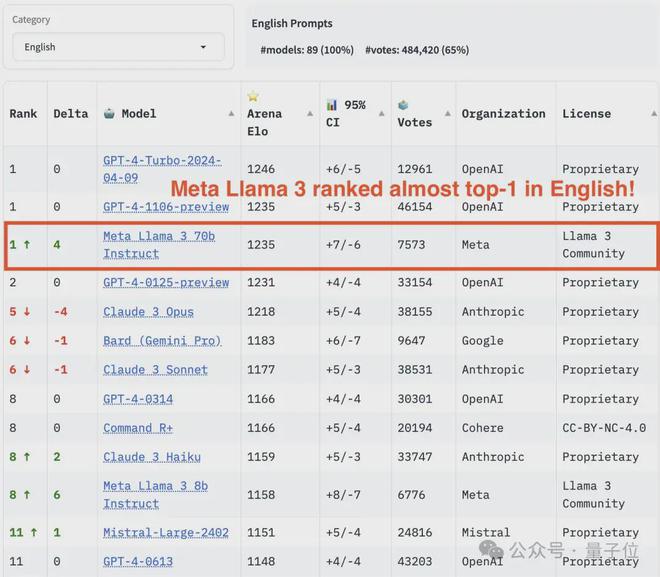

大模型评测社区 LMSYS 发布了一份大模型排行榜单,Llama 3 位列第五,英文单项与 GPT-4 并列第一。

不同于其他 Benchmark,这份榜单的依据是模型一对一 battle,由全网测评者自行命题并打分。

最终,Llama 3 取得了榜单中的第五名,排在前面的是 GPT-4 的三个不同版本,以及 Claude 3 超大杯 Opus。

而在英文单项榜单中,Llama 3 反超了 Claude,与 GPT-4 打成了平手。

对于这一结果,Meta 的首席科学家 LeCun 十分高兴,转发了推文并留下了一个“Nice”。

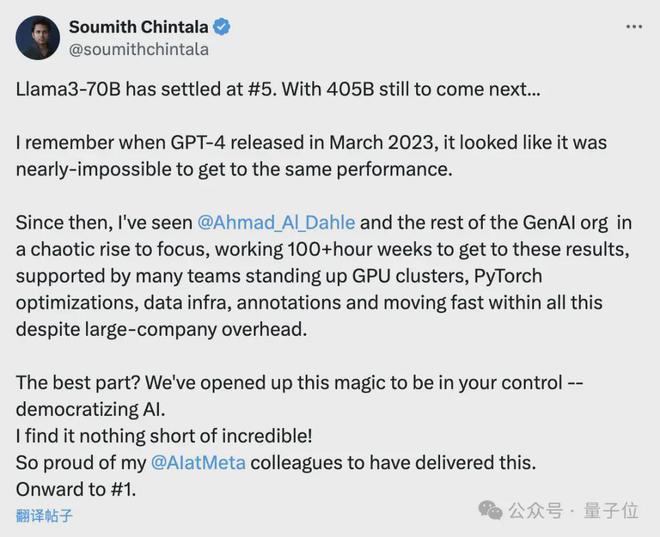

PyTorch 之父 Soumith Chintala 也激动地表示,这样的成果令人难以置信,对 Meta 感到骄傲。

Llama 3 的 400B 版本还没出来,单靠 70B 参数就获得了第五名……我还记得去年三月 GPT-4 发布的时候,达到与之相同的表现几乎是一件不可能的事。

……

现在 AI 的普及化实在是令人难以置信,我对 Meta AI 的同仁们做出这样的成功感到非常骄傲。

那么,这份榜单具体展示了什么样的结果呢?

近 90 个模型对战 75 万轮

截至最新榜单发布,LMSYS 共收集了近 75 万次大模型 solo 对战结果,涉及的模型达到了 89 款。

其中,Llama 3 参与过的有 1.27 万次,GPT-4 则有多个不同版本,最多的参与了 6.8 万次。

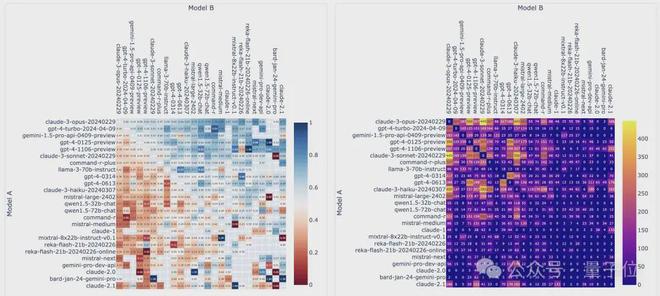

下面这张图展示了部分热门模型的比拼次数和胜率,图中的两项指标都没有统计平局的次数。

榜单方面,LMSYS 分成了总榜和多个子榜单,GPT-4-Turbo 位列第一,与之并列的是早一些的 1106 版本,以及 Claude 3 超大杯 Opus。

另一个版本(0125)的 GPT-4 则位列其后,紧接着就是 Llama 3 了。

不过比较有意思的是,较新一些的 0125,表现还不如老版本 1106。

而在英文单项榜单中,Llama 3 的成绩直接和两款 GPT-4 打成了平手,还反超了 0125 版本。

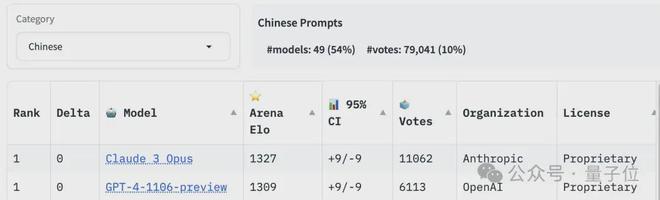

中文能力排行榜的第一名则由 Claude 3 Opus 和 GPT-4-1106 共享,Llama 3 则已经排到了 20 名开外。

除了语言能力之外,榜单中还设置了长文本和代码能力排名,Llama 3 也都名列前茅。

不过,LMSYS 的“游戏规则”又具体是什么样的呢?

人人都可参与的大模型评测

这是一个人人都可以参与的大模型测试,题目和评价标准,都由参与者自行决定。

而具体的“竞技”过程,又分成了 battle 和 side-by-side 两种模式。

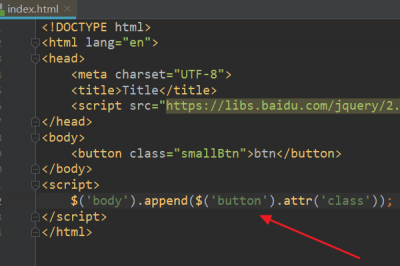

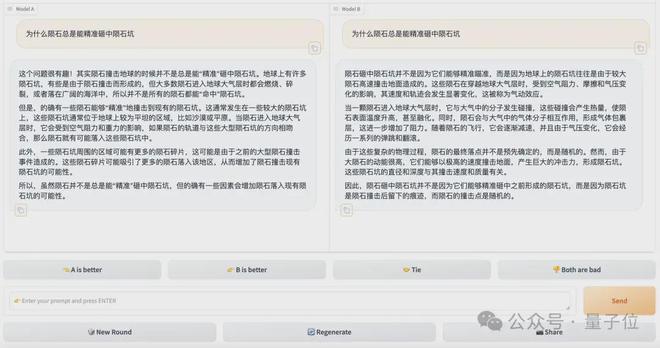

battle 模式下,在测试界面输入好问题之后,系统会随机调用库中的两个模型,而测试者并不知道系统到底抽中了谁,界面中只显示“模型A”和“模型B”。

在模型输出答案后,测评人需要选择哪个更好,或者是平手,当然如果模型的表现都不符合预期,也有相应的选项。

只有在做出选择之后,模型的身份才会被揭开。

side-by-side 则是由用户选择指定的模型来 PK,其余测试流程与 battle 模式相同

不过,只有 battle 的匿名模式下的投票结果才会被统计,且在对话过程中模型不小心暴露身份就会导致结果失效。

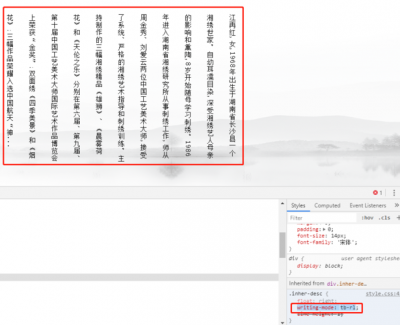

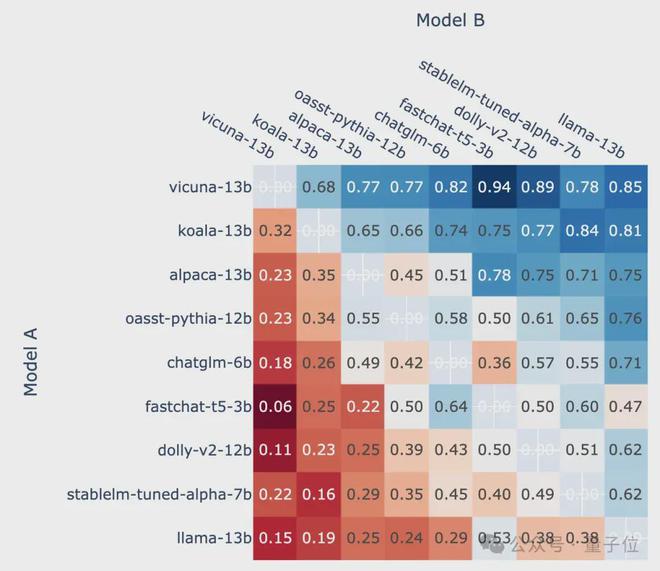

按照各个模型对其他模型的 Win Rate,可以绘制出这样的图像:

△示意图,较早版本

而最终的排行榜,是利用 Win Rate 数据,通过 Elo 评价系统换算成分数得到的。

Elo 评价系统是一种计算玩家相对技能水平的方法,由美国物理学教授 Arpad Elo 设计。

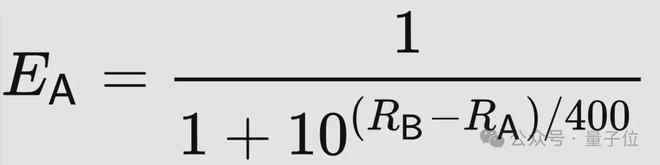

具体到 LMSYS,在初始条件下,所有模型的评分(R)都被设定为 1000,然后根据这样的公式计算出期待胜率(E)。

随着测试的不断进行,会根据实际得分(S)对评分进行修正,S有1、0 和 0.5 三种取值,分别对应获胜、失败和平手三种情况。

修正算法如下式所示,其中K为系数,需要测试者根据实际情况调整。

最终将所有有效数据纳入计算后,就得到了模型的 Elo 评分。

不过实际操作过程中,LMSYS 团队发现这种算法的稳定性存在不足,于是又采用了统计学方法进行了修正。

他们利用 Bootstrap 方法进行重复采样,得到了更稳定的结果,并估计了置信度区间。

最终修正后的 Elo 评分,就成了榜单中的排列依据。

One More Thing

Llama 3 已经可以在大模型推理平台 Groq(不是马斯克的 Grok)上跑了。

这个平台的最大亮点就是“快”,之前用 Mixtral 模型跑出过每秒近 500 token 的速度。

跑起 Llama 3,也是相当迅速,实测 70B 可以跑到每秒约 300 Token,8B 版本更是接近了 800。

参考链接:

[1]https://lmsys.org/blog/2023-05-03-arena/