鱼羊发自凹非寺

量子位公众号 QbitAI

北大和字节联手搞了个大的:

提出图像生成新范式,从预测下一个 token 变成预测下一级分辨率,效果超越 Sora 核心组件 Diffusion Transformer(DiT)。

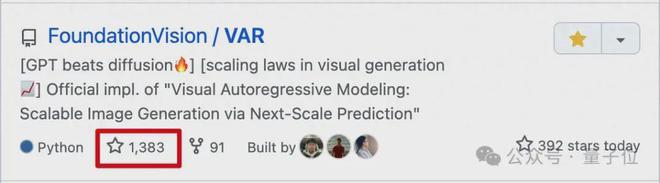

并且代码开源,短短几天已经揽下 1.3k 标星,登上 GitHub 趋势榜。

具体是个什么效果?

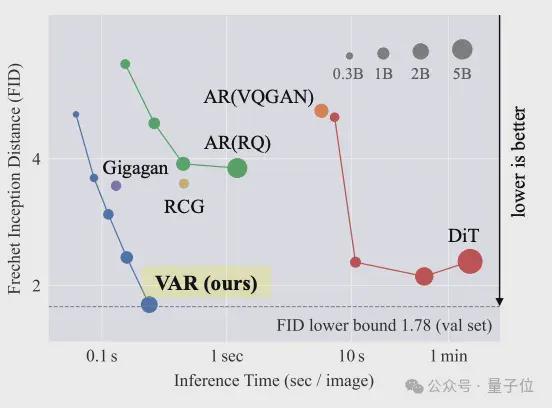

实验数据上,这个名为 VAR(Visual Autoregressive Modeling)的新方法不仅图像生成质量超过 DiT 等传统 SOTA,推理速度也提高了 20+ 倍。

这也是自回归模型首次在图像生成领域击败 DiT。

直观感受上,话不多说,直接看图:

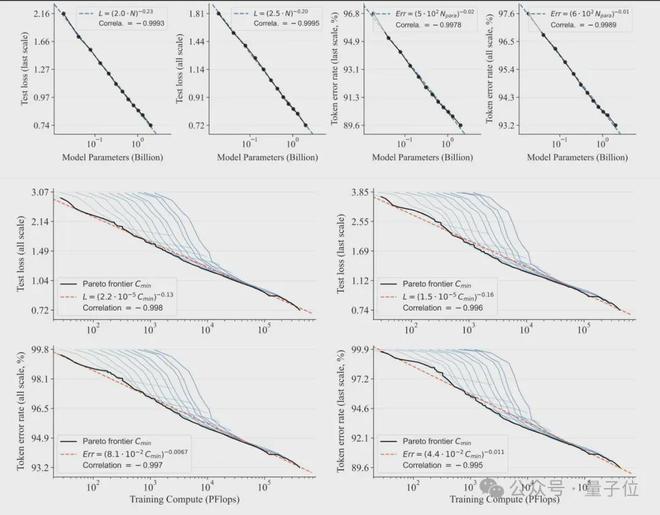

值得一提的是,研究人员还在 VAR 上,观察到了大语言模型同款的 Scaling Laws 和零样本任务泛化。

论文代码上线,已经引发不少专业讨论。

有网友表示有被惊到,顿时觉得其他扩散架构的论文有点索然无味。

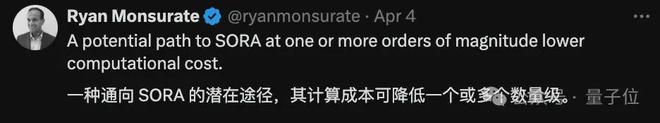

还有人认为,这是一种通向 Sora 的更便宜的潜在途径,计算成本可降低一个乃至多个数量级。

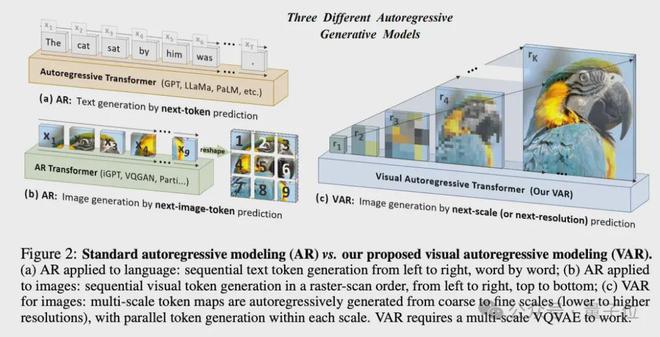

预测下一级分辨率

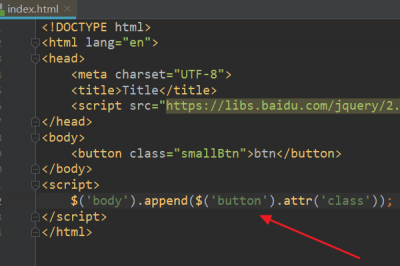

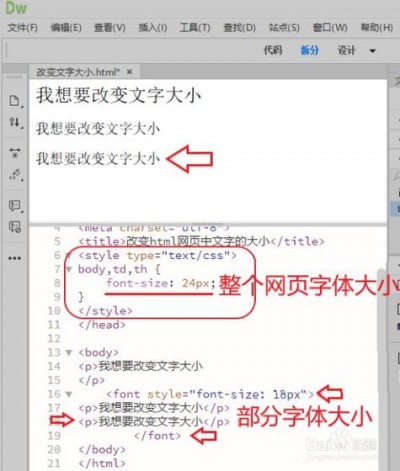

简单来说,VAR 的核心创新,就是用预测下一级分辨率,替代了预测下一个 token的传统自回归方法。

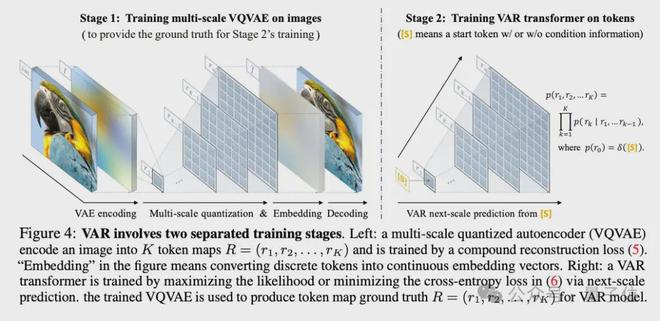

VAR 的训练分为两个阶段。

第一阶段,VAR 引入了多尺度离散表示,使用 VQ-VAE 将连续图像编码为一系列离散的 token map,每个 token map 有不同的分辨率。

第二阶段,主要是对 VAR Transformer 的训练,通过预测更高分辨率的图像,来进一步优化模型。具体过程是这样的:

从最低分辨率(比如1×1)的 token map 开始,预测下一级分辨率(比如4×4)的完整 token map,并以此类推,直到生成最高分辨率的 token map(比如 256×256)。在预测每个尺度的 token map 时,基于 Transformer,模型会考虑之前所有步骤生成的映射信息。

在第二阶段中,之前训练好的 VQ-VAE 模型发挥了重要作用:为 VAR 提供了“参考答案”。这能帮助 VAR 更准确地学习和预测图像。

另外,在每个尺度内,VAR 是并行地预测所有位置的 token,而不是线性逐个预测,这大大提高了生成效率。

研究人员指出,采用这样的方法,VAR 更符合人类视觉感知从整体到局部的特点,并能保留图像的空间局部性。

符合 Scaling Laws

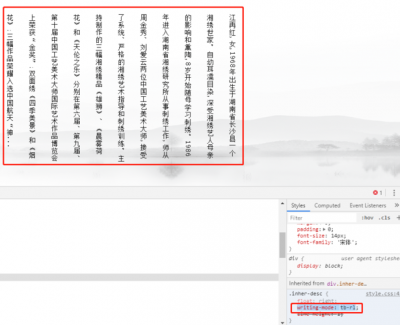

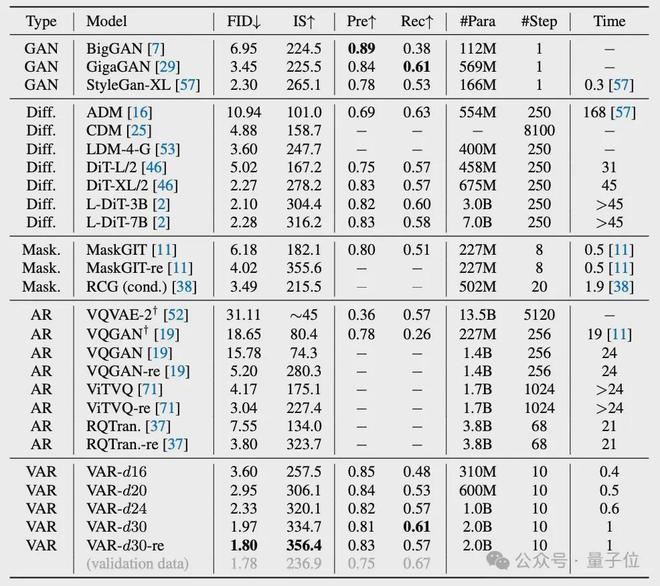

从实验结果来看,在图像生成质量、推理速度、数据效率和可扩展性等方面,VAR 都超过了 DiT。

在 ImageNet 256×256 上,VAR 将 FID 从 18.65 降到了 1.8,IS 从 80.4 提高到 356.4,显著改善了自回归模型基线。

注:FID 越低,说明生成图像的质量和多样性越接近真实图像。

推理速度方面,相较于传统自回归模型,VAR 实现了约 20 倍的效率提升。而 DiT 消耗的时间是 VAR 的 45 倍。

数据效率方面,VAR 只需要 350 个训练周期(epoch),远少于 DiT-XL/2 的 1400 个。

可扩展性方面,研究人员观察到 VAR 有类似于大语言模型的 Scaling Laws:随着模型尺寸和计算资源的增加,模型性能持续提升。

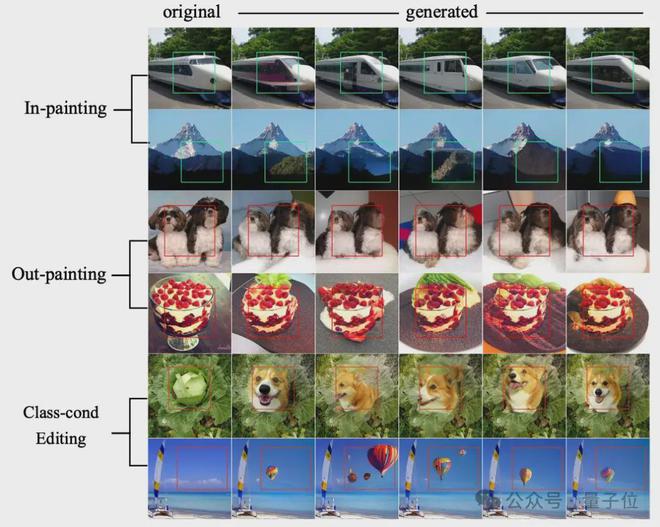

另外,在图像修补、扩展和编辑等下游任务的零样本评估中,VAR 表现出了出色的泛化能力。

目前,在 GitHub 仓库中,推理示例、demo、模型权重和训练代码均已上线。

不过,在更多讨论之中,也有网友提出了一些问题:VAR 不如扩散模型灵活,并且在分辨率上存在扩展问题。

北大字节联合出品

VAR 的作者们,来自字节跳动 AI Lab 和北大王立威团队。

一作田柯宇,本科毕业自北航,目前是北大 CS 研究生,师从北京大学信息科学技术学院教授王立威。2021 年开始在字节 AI Lab 实习。

论文通讯作者,是字节跳动 AI Lab 研究员袁泽寰和王立威。

袁泽寰 2017 年博士毕业于南京大学,目前专注于计算机视觉和机器学习研究。王立威从事机器学习研究 20 余年,是首届“优青”获得者。

该项目的项目主管,是字节跳动广告生成 AI 研究主管 Yi jiang。他硕士毕业于浙江大学,目前的研究重点是视觉基础模型、深度生成模型和大语言模型。

参考链接:

[1]论文:https://arxiv.org/abs/2404.02905

[2]项目主页:https://github.com/FoundationVision/VAR

— 完 —