鱼羊发自凹非寺

量子位公众号 QbitAI

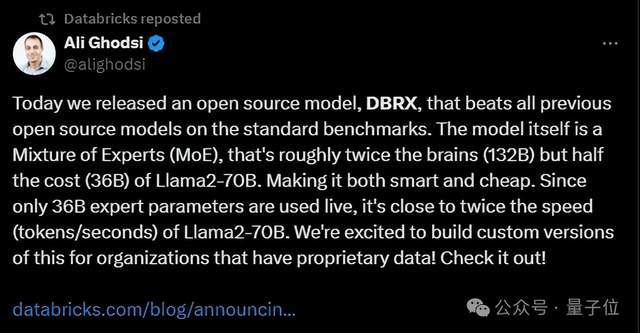

“最强”开源大模型之争,又有新王入局:

大数据巨头 Databricks,发布 MoE 大模型 DBRX,并宣称:它在基准测试中击败了此前所有开源模型。

包括同为混合专家模型的 Grok-1 和 Mixtral。

新王搅局,迅速引发了开源社区的热议。

毕竟,仅从纸面数据来看,DBRX 颇具特点:总参数量为 1320 亿,但因为是混合专家模型,每次激活参数量仅为 360 亿。

就是说,在总参数量接近 Llama2-70B 的 2 倍的情况下,DBRX 的生成速度也比 Llama2-70B 快 1 倍。

另外,DBRX 是在 12T token 上从头训练的,训练数据量是 Llama2 的 6 倍,远高于 Chinchilla 定律推荐量。

网友们的第一反应 be like:

首席科学家:打赌输了就把头发染蓝

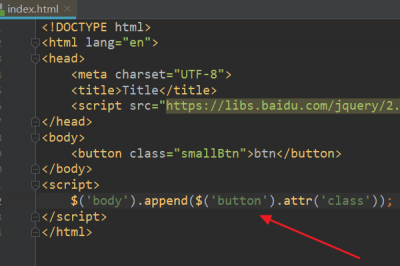

来看 DBRX 的具体细节。

DBRX 由 16 个专家模型组成,每次训练推理会有 4 个专家处于激活状态。其上下文长度为 32K。

为了训练 DBRX,Databricks 团队从云厂商那里租用了 3072 个 H100。

一个细节是,团队向 Wired 透露,经过两个月的训练之后,DBRX 已经在基准测试中取得了不错的分数。而在那个时候,他们买的云资源还能再跑一个星期。

团队因此产生了小小的分歧:是用这些资源来训练一个小杯版本,还是再投喂给模型一些高质量数据,用课程学习(curriculum learning)的方法来提高 DBRX 在一些特定任务上的能力?

经过一番热烈的内部讨论,Databricks 团队最终决定走课程学习路线。

正是这一决策使他们收获颇丰:

Databricks 首席科学家 Jonathan Frankle(就叫他老弗吧)认为,课程学习使得 DBRX“产生了有意义的变化”。

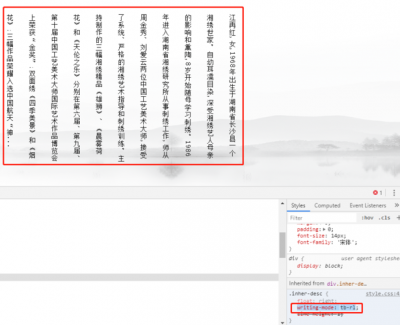

具象化一点来说,就是老弗本来觉得 DBRX 可能搞不太定代码生成,还打赌说如果他判断错了,就去把头发染成蓝色。

而这是他的最新照片:

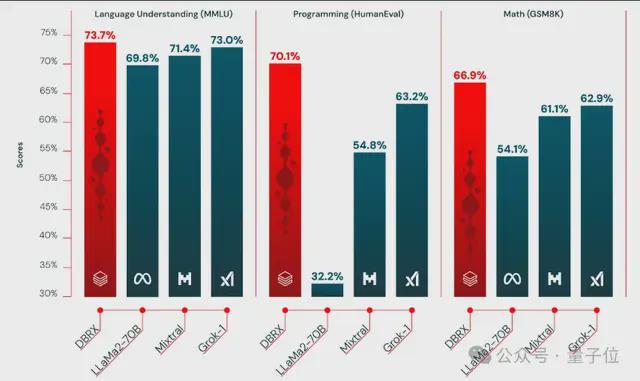

回到正题,DBRX 的测试结果显示,它在语言理解、编程、数学和逻辑方面都达到了 SOTA,击败包括 Llama2-70B、Mixtral 和 Grok-1 在内的一众开源大模型。

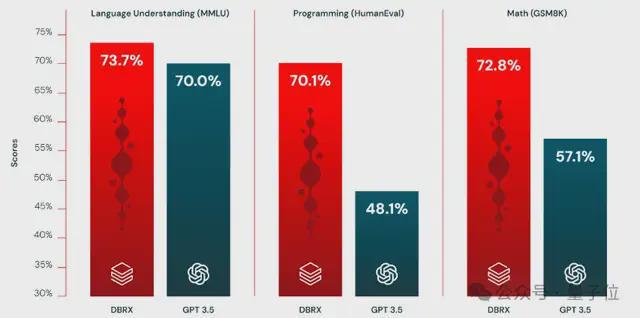

还在大多数基准测试中都击败了 GPT-3.5。

Databricks 这次开源了 DBRX 的两个版本:DBRX Base 和 DBRX Instruct,前者是预训练基础模型,后者则经过指令微调。

老弗还对 Wired 透露,他们团队接下来计划对模型训练的那个“最后一周”展开研究,看看 DBRX 这样强大的模型是如何在其中收获额外技能的。

值得一提的是,去年 6 月,Databricks 以 13 亿美元(约 93 亿人民币)的价格,买下了仅 62 名员工的 AI 初创公司 MosaicML——

就是发布了 MPT 系列开源模型的那家。

老弗当时就是 MosaicML 的首席科学家。此后,他和他的团队一起留在了 Databricks。

开源社区嗨翻

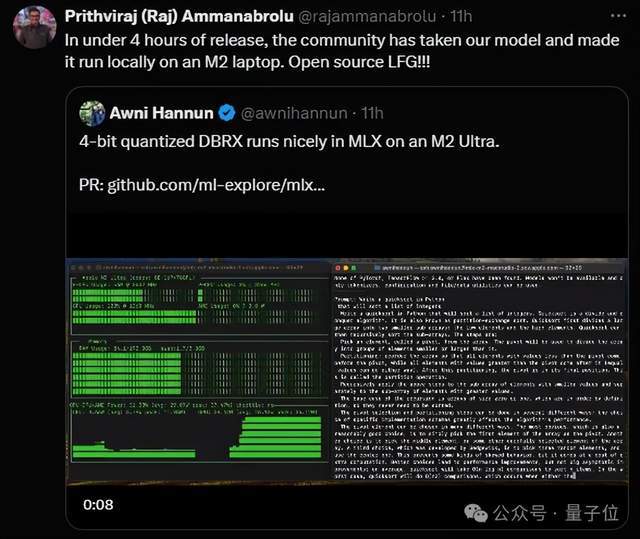

DBRX 发布不到 4 小时,已经有人把它成功部署到苹果 M2 芯片笔记本电脑上了。

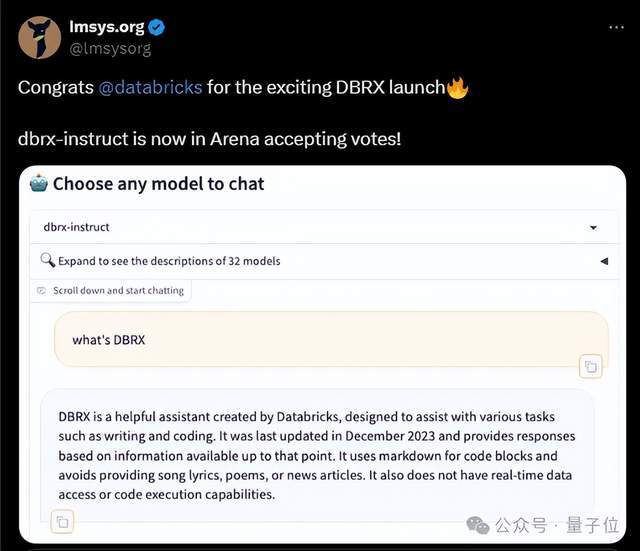

而大模型竞技场也第一时间开放了 DBRX-instruct 的投票。

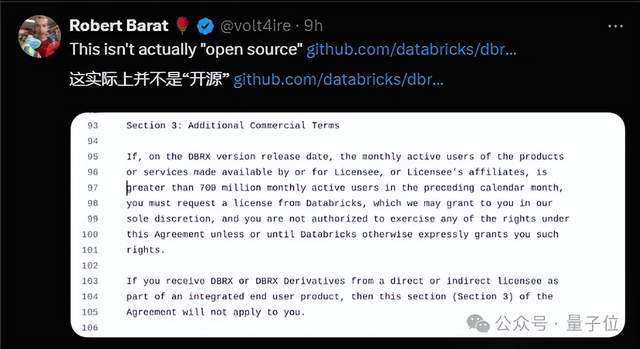

不过,也有人对 DBRX 的“开源”提出了质疑:

根据 Databricks 公布的协议,基于 DBRX 打造的产品,如果月活超过 7 亿,就必须另行向 Databricks 提交申请。

参考连接:

[1]https://www.databricks.com/blog/announcing-dbrx-new-standard-efficient-open-source-customizable-llms

[2]https://github.com/databricks/dbrx

— 完 —